Η OpenAI ανακοίνωσε συνεργασία με AMD, NVIDIA, Intel, Microsoft και Broadcom για την ανάπτυξη του MRC, ενός νέου πρωτοκόλλου που στοχεύει να βελτιώσει την απόδοση και την ανθεκτικότητα των δικτύων σε μεγάλα AI training clusters.

Το MRC, δηλαδή Multipath Reliable Connection, παρουσιάζεται ως λύση για ένα από τα κρίσιμα προβλήματα στην εκπαίδευση μεγάλων AI μοντέλων: τη μεταφορά δεδομένων ανάμεσα σε τεράστια clusters από GPUs. Όταν ακόμη και μία μεταφορά καθυστερήσει, η διαδικασία μπορεί να επηρεαστεί συνολικά, αφήνοντας GPUs ανενεργές.

Σύμφωνα με την OpenAI, οι βασικές αιτίες αυτών των καθυστερήσεων είναι η συμφόρηση του δικτύου, οι αστοχίες σε συνδέσεις και τα προβλήματα σε συσκευές. Όσο μεγαλώνει το cluster, τόσο πιο συχνά εμφανίζονται αυτά τα εμπόδια.

Πώς λειτουργεί το MRC

Η OpenAI αναφέρει ότι εργάστηκε τα τελευταία δύο χρόνια με AMD, Broadcom, Intel, Microsoft και NVIDIA πάνω στο MRC, το οποίο ενσωματώνεται στα νεότερα network interfaces των 800 Gb/s. Ο στόχος είναι μια μεμονωμένη μεταφορά να μπορεί να μοιράζεται σε εκατοντάδες αδιάκοπες διαδρομές, να παρακάμπτει βλάβες μέσα σε microseconds και να λειτουργεί με απλούστερα network control planes.

Η εταιρεία εξηγεί ότι, αντί να αντιμετωπίζεται κάθε network interface ως μία σύνδεση των 800 Gb/s, το interface χωρίζεται σε μικρότερες συνδέσεις. Για παράδειγμα, ένα interface μπορεί να συνδεθεί με οκτώ διαφορετικά switches, δημιουργώντας οκτώ παράλληλα δίκτυα, ή planes, που λειτουργούν στα 100 Gb/s το καθένα.

«Αυτή η αλλαγή έχει μεγάλη επίδραση στο σχήμα του cluster. Ένα switch που μπορεί να συνδέσει 64 ports στα 800 Gb/s μπορεί αντίθετα να συνδέσει 512 ports στα 100 Gb/s. Αυτό επιτρέπει τη δημιουργία ενός δικτύου που συνδέει πλήρως περίπου 131.000 GPUs με μόνο δύο tiers από switches. Ένα συμβατικό δίκτυο 800 Gb/s θα απαιτούσε τρία ή τέσσερα tiers», αναφέρει η OpenAI.

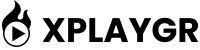

Ήδη σε χρήση σε supercomputers της OpenAI

Το MRC θα επεκτείνει το υπάρχον RDMA over RoCE, δηλαδή Converged Ethernet, επιτρέποντας hardware-accelerated remote direct memory access για GPUs και CPUs. Η OpenAI έχει ήδη αναπτύξει το πρωτόκολλο σε supercomputers που φιλοξενούν NVIDIA GB200 Blackwell GPUs και χρησιμοποιούνται για την εκπαίδευση frontier μοντέλων.

Στα παραδείγματα που αναφέρονται περιλαμβάνονται η Oracle Cloud Infrastructure στο Abilene του Texas και τα Fairwater supercomputers της Microsoft. Το MRC έχει ήδη χρησιμοποιηθεί για την εκπαίδευση πολλαπλών μοντέλων της OpenAI σε NVIDIA και Broadcom hardware.

Το νέο πρωτόκολλο έχει κυκλοφορήσει μέσω του Open Compute Project, ώστε να μπορεί να χρησιμοποιηθεί ευρύτερα από εταιρείες του AI χώρου. Η OpenAI το συνδέει και με το Stargate supercomputer της Oracle Cloud Infrastructure στο Abilene, το οποίο έχει στόχο να φτάσει τα 10GW AI compute έως το 2029, έχοντας ήδη αναπτύξει πάνω από 3GW τους τελευταίους τρεις μήνες.

Ακολουθήστε το XplayGR στο Google News για να μαθαίνετε πρώτοι όλες τις εξελίξεις από τον χώρο του gaming και της ψυχαγωγίας.

Δείτε όλες τις τελευταίες ειδήσεις στο XplayGR.com.